Generative Machine-Learning-Systeme erleichtern das Generieren von Fake-News massiv |  |

BiblioMap

BiblioMap

Bemerkungen

Bemerkungen

döbeli honegger prognostiziert, infolge

der neuen tools werde die informationsflut

ansteigen. auch die flut an fakenews

dürfte zunehmen.

Von Jochen Zenthöfer im Text Wie ChatGPT die Schule verändern wird (2023) Nach der Publikation von Chat-GPT im

Herbst 2022 warnten viele Kommentatoren

davor, dass die Desinformation

im Internet sich im KI-Zeitalter vervielfachen

und ihre Wirkung verstärken

könnte.

Von Gioia Da Silva im Text Chat-GPT macht Stimmung gegen Kiew (2024)  Natürlich kann man mithilfe von generativen

Textsystemen Desinformation in einer sprachlich

hohen Qualität sehr, sehr schnell erstellen.

Aber wir sollten nie sagen: Die KI war’s! Da sind ja

Menschen dahinter.

Natürlich kann man mithilfe von generativen

Textsystemen Desinformation in einer sprachlich

hohen Qualität sehr, sehr schnell erstellen.

Aber wir sollten nie sagen: Die KI war’s! Da sind ja

Menschen dahinter.Zwar ist bekannt, dass die Reichweite

von ausländischen Desinformationskampagnen

noch immer wesentlich

kleiner ist als jene von etablierten

Medien. Dennoch glauben Experten,

KI-Tools wie Chat-GPT vereinfachten

die Verbreitung von Desinformation.

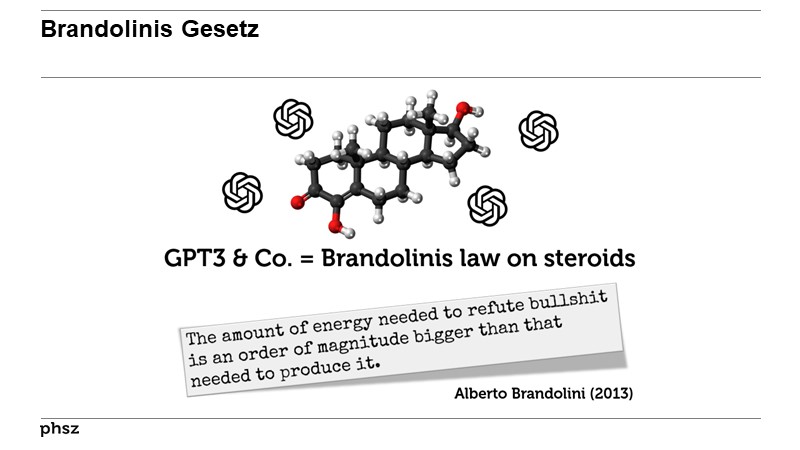

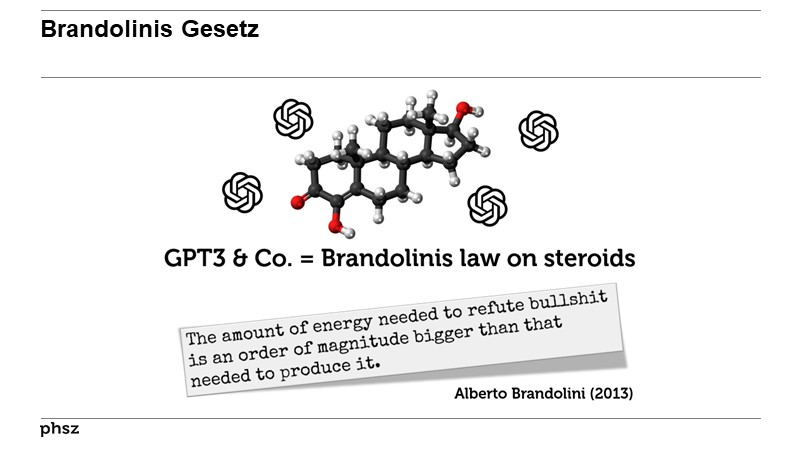

Von Gioia Da Silva im Text Chat-GPT macht Stimmung gegen Kiew (2024) Döbeli Honegger sagt, es werde wichtiger denn je, Schülerinnen und Schülern Medienkompetenz beizubringen. ChatGPT und alle anderen Text- Roboter, die jetzt in der Pipeline sind, werden zu einer Flut an geschriebenen Informationen führen. Fake News werden immer seriöser daherkommen. In der Schule müsse man lernen, wie ein KI-Text als solcher zu erkennen sei. Das müsse «Teil der Allgemeinbildung» werden, sagt der Dozent.

Von Geri Holdener im Text Professor der PH Schwyz testet Textroboter und gibt Tipps für Schulen (2023) Indeed, new state-of-the-art artificial intelligence (AI) technologies can now generate text that

mimics the style and substance of real news stories while overcoming the bandwidth limits that face

human-generated text. If these models enable malicious actors to generate and publish crediblesounding

news stories at scale, then the prospect for misinformation, defined as “false or misleading

information,” 3 is high: the volume of inauthentic media could balloon, and the ease of text synthesis

might further enable the coordinated hyper-targeting of articles to individual groups.

Von Sarah Kreps, Miles McCain, Miles Brundage im Text All the News that’s Fit to Fabricate (2020)  Wie gross ist die Gefahr, dass durch KI noch viel mehr Fake News, also Falschmeldungen, verbreitet werden?

Wie gross ist die Gefahr, dass durch KI noch viel mehr Fake News, also Falschmeldungen, verbreitet werden?Selbstverständlich werden Fake News einfacher und perfekter herstellbar. Wir müssen uns darauf einstellen, dass es immer schwieriger wird, Texte, Bilder und Videos als Fälschungen zu entlarven. Obwohl Allgemeinbildung und Medienkompetenz bis zu einem gewissen Grad bei der Erkennung helfen, müssen wir uns darauf vorbereiten, dass es zur sogenannten Lügner-Dividende kommt: Wenn alles fälschbar scheint, so nimmt auch die Glaubwürdigkeit seriöser Quellen ab, was für die Demokratie gefährlich ist.

Was wir heute erleben, ist erst der

Anfang. Das Spektrum wird von solchen

leicht durchschaubaren und fast lustigen

Fakes bis zu seriös aufgemachten Fälschungen

von Nachrichtenseiten reichen.

Diese könnten zum Beispiel gefälschte

Lokalnachrichten an Hunderten von

Orten in den umkämpften Swing States

verbreiten: eloquente und überzeugende

Geschichten über vermeintliche Skandale

von Joe Biden oder Trump oder

einem lokalen Kandidaten für den Kongress.

Denkbar wäre auch, dass Wähler

automatisierteAnrufe einer KI-generierten

Stimme erhalten, die wie Biden klingt

und behauptet, dass die Wahl um einen

Tag nach hinten verschoben wurde. Die

Möglichkeiten sind unbegrenzt.

Von Steven Brill im Text «Wir haben 166 Nachrichtenseiten gefunden, die von KI geschrieben wurden» (2023)  Als Reaktion darauf haben sich sieben der großen Tech-Konzerne, die in

die Entwicklung generativer KI involviert sind (Amazon, Anthropic, Google,

Inflection, Meta, Microsoft und OpenAI), im Sommer 2023 dazu

entschlossen, ihren Beitrag zu leisten. Sie verpflichteten sich gemeinsam und

freiwillig (wenn auch mit einem ordentlichen Anstupser durch den USPräsidenten

Joe Biden) zur «Entwicklung robuster technischer Mechanismen,

die sicherstellen, dass die Nutzer wissen, wann es sich um KI-Inhalte

handelt, z.B. durch ein Wasserzeichensystem. Diese Maßnahme ermöglicht

es, dass sich Kreativität mit KI weiter entfalten kann, aber gleichzeitig die

Gefahr von Betrug und Täuschung verringert wird.»

Als Reaktion darauf haben sich sieben der großen Tech-Konzerne, die in

die Entwicklung generativer KI involviert sind (Amazon, Anthropic, Google,

Inflection, Meta, Microsoft und OpenAI), im Sommer 2023 dazu

entschlossen, ihren Beitrag zu leisten. Sie verpflichteten sich gemeinsam und

freiwillig (wenn auch mit einem ordentlichen Anstupser durch den USPräsidenten

Joe Biden) zur «Entwicklung robuster technischer Mechanismen,

die sicherstellen, dass die Nutzer wissen, wann es sich um KI-Inhalte

handelt, z.B. durch ein Wasserzeichensystem. Diese Maßnahme ermöglicht

es, dass sich Kreativität mit KI weiter entfalten kann, aber gleichzeitig die

Gefahr von Betrug und Täuschung verringert wird.»We found that people can be manipulated by AI-generated text such that they cannot discern real from synthetic content. The narrower consequence of a manipulable public is that misinformation campaigns have a ripe target. Malicious actors can easily produce AI-generated content and generate confusion about the truth, undermining trust in democratic institutions such as the media. More generally, however, the ease of manipulation suggests avenues for misinformation not in service of political persuasion but instead in sowing confusion and distrust. Following Kant’s belief in “a common sense as the necessary condition of the universal communicability of our knowledge," the erosion of common reference points has the potential to undermine the basis of coherent public policy.

Von Sarah Kreps, Miles McCain, Miles Brundage im Text All the News that’s Fit to Fabricate (2020)  AI’s ability to generate deep fake videos and new stories doesn’t frighten meeither. It just puts us back where we were when we used to get our newsfrom printed text. Anyone can put anything into the same font, print it out,and pass it around. The veracity of a news story has nothing to do with itsproduction value and everything to do with the integrity of the institutionproducing it. That’s why news organizations are supposed to work within asystem of “journalistic standards and practices.” They teach this stuff injournalism school, and places like BBC (and sometimes CNN) employ it. Yourwillingness to consider the ideas in this piece is dependent on your trust inme, a human being with a reputation at stake and, hopefully, a track recordof at least attempting to write truthfully.

AI’s ability to generate deep fake videos and new stories doesn’t frighten meeither. It just puts us back where we were when we used to get our newsfrom printed text. Anyone can put anything into the same font, print it out,and pass it around. The veracity of a news story has nothing to do with itsproduction value and everything to do with the integrity of the institutionproducing it. That’s why news organizations are supposed to work within asystem of “journalistic standards and practices.” They teach this stuff injournalism school, and places like BBC (and sometimes CNN) employ it. Yourwillingness to consider the ideas in this piece is dependent on your trust inme, a human being with a reputation at stake and, hopefully, a track recordof at least attempting to write truthfully.A third category of risk involves

bad actors taking advantage of the ability of large LMs to produce

large quantities of seemingly coherent texts on specific topics on

demand in cases where those deploying the LM have no investment

in the truth of the generated text. These include prosaic cases, such

as services set up to ‘automatically’ write term papers or interact on

social media,23 as well as use cases connected to promoting extremism.

For example, McGuffie and Newhouse [80] show how GPT-3

could be used to generate text in the persona of a conspiracy theorist,

which in turn could be used to populate extremist recruitment

message boards. This would give such groups a cheap way to boost

recruitment by making human targets feel like they were among

many like-minded people.

Von Emily M. Bender, Timnit Gebru, Angelina McMillan-Major, Shmargaret Shmitchell im Text On the Dangers of Stochastic Parrots (2021)  Ich kann mit ChatGPT zum Beispiel einenPresse- oder Blogbeitrag in 30 Sekunden oder weniger schreiben.Ich könnte aber auch Fake-News in der gleichen Geschwindigkeitproduzieren, indem ich irgendetwas behaupte und ein paarStichworte dazu eingebe. ChatGPT kann somit gleichermaßenpositiv wie negativ verwendet werden.

Im digitalen Raum kann der Missbrauch über die Reichweitezudem enorm vergrößert werden. Ich kann Fake-News extremschnell verbreiten und Bots einsetzen, die Feedback geben. Mankann damit täuschende, betrügerische und manipulierendeMedien betreiben. Neben Text geht es zunehmend mehr auch umFakes in Form von Bildern und Videos. Wir können kaum nochzwischen Fiktion und Realität unterscheiden, weil die generativenKI-Tools für die Produktion von Bildern und Videos in sehr kurzerZeit drastisch besser geworden sind.

Ich kann mit ChatGPT zum Beispiel einenPresse- oder Blogbeitrag in 30 Sekunden oder weniger schreiben.Ich könnte aber auch Fake-News in der gleichen Geschwindigkeitproduzieren, indem ich irgendetwas behaupte und ein paarStichworte dazu eingebe. ChatGPT kann somit gleichermaßenpositiv wie negativ verwendet werden.

Im digitalen Raum kann der Missbrauch über die Reichweitezudem enorm vergrößert werden. Ich kann Fake-News extremschnell verbreiten und Bots einsetzen, die Feedback geben. Mankann damit täuschende, betrügerische und manipulierendeMedien betreiben. Neben Text geht es zunehmend mehr auch umFakes in Form von Bildern und Videos. Wir können kaum nochzwischen Fiktion und Realität unterscheiden, weil die generativenKI-Tools für die Produktion von Bildern und Videos in sehr kurzerZeit drastisch besser geworden sind. 15 Vorträge von Beat mit Bezug

15 Vorträge von Beat mit Bezug

- ChatGPT - der iPhone-Moment für KI?

Klausur PHSZ, Oberägeri, 14.02.2023

- ChatGPT und die (informatische (Schul-))Bildung

Ausschuss "Bildung, Fachkräfte und Diversität" von digitalswitzerland, 07.03.2023

- Schule, Digitalisierung und die Rolle der Informatik

Landesinformatiktag Hamburg und Schleswig-Holstein, 25.03.2023

- ChatGPT - der iPhone-Moment des maschinellen Lernens

NMS Bern, 07.06.2023

- KVreform GPT

Kaufmännische Berufsschule Schwyz, 05.07.2023

- BBZGPT

Berufsbildungszentrum Goldau, 17.08.2023

- Nachrichtenkompetenz – und jetzt auch noch ChatGPT & Co.

Tagung "Nachrichtenkompetenz auf Sekundarstufe II" von ZHAW und SRG public value, 03.11.2023

- ChatGPT & Co. – eine Etappe auf der Reise nach Digitalien

CAS Lernreise, 19.01.2024

- Wenn ChatGPT in der Lehrer:innenbildung mitredet

(Video des Referats)

Tag der Lehre der PHZH, 01.02.2024

- Was will uns ChatGPT sagen?

8. Pädagogischer Dialog Liechtenstein, Vaduz, 21.02.2024

- Sprachmaschinen.

Deutschsprachige AG Fremdsprachen der EDK, PHZH, 20.03.2024

- Überfluten uns ChatGPT & Co.?

Tagung des Berufsverbands Schulleitungen Bern

Schwellenmätteli Bern, 24.05.2024

- Generative Machine-Learning-Systeme in der Bildung

VR- und GL-Retraite der Orell Füssli Gruppe

Hasliberg, 12.06.2024

- Wenn das Digitale in der Bildung mitzureden beginnt

Bildungstag Kanton Glarus, 04.09.2024

- Zwischen Experimentierfreude und Überforderung

Kaderanlass, Schulkreis Uto Zürich, 03.06.2025

4 Erwähnungen auf anderen Websites im Umfeld von Beat Döbeli Honegger

4 Erwähnungen auf anderen Websites im Umfeld von Beat Döbeli Honegger

| Website | Webseite | Datum |

|---|---|---|

| ChatGPT & Co. und die Schule | Gesellschaftliches | 05.04.2023 |

| ChatGPT & Co. und die Schule | Literatur | 05.04.2023 |

| ChatGPT & Co. und die Schule | Textgeneratoren machen Medienkompetenz noch wichtiger | 08.04.2023 |

| ChatGPT & Co. und die Schule | Umgang mit Textgeneratoren als Teil von information literacy | 14.04.2023 |

Zitationsgraph

Zitationsgraph

Zitationsgraph (Beta-Test mit vis.js)

Zitationsgraph (Beta-Test mit vis.js)

Zeitleiste

Zeitleiste

48 Erwähnungen

48 Erwähnungen

- Umgang mit generativen KI-Modellen - Ein Handlungsleitfaden (Thüringer Ministerium für Bildung. Jugend und Sport)

- AI risk must be treated as seriously as climate crisis, says Google DeepMind chief (Dan Milmo)

- Deepfakes - Wie gefälschte Botschaften im Netz unsere Demokratie gefährden und unsere Leben zerstören können (Nina Schick) (2020)

- 3. Der Westen - Bedrohung aus dem Inneren

- All the News that’s Fit to Fabricate - AI-Generated Text as a Tool of Media Misinformation (Sarah Kreps, Miles McCain, Miles Brundage) (2020)

- On the Dangers of Stochastic Parrots - Can Language Models Be Too Big? (Emily M. Bender, Timnit Gebru, Angelina McMillan-Major, Shmargaret Shmitchell) (2021)

- The Medium is the Message - The real and imagined dangers of AI (Douglas Rushkoff) (2022)

- Der Geldgenerator (Heike Buchter) (2023)

- Professor der PH Schwyz testet Textroboter und gibt Tipps für Schulen (Geri Holdener) (2023)

- ChatGPT & Schule - Einschätzungen der Professur „Digitalisierung und Bildung“ der Pädagogischen Hochschule Schwyz (Beat Döbeli Honegger) (2023)

- Wie ChatGPT die Schule verändern wird (Jochen Zenthöfer) (2023)

- The A.I. Dilemma (Tristan Harris, Aza Raskin) (2023)

- info7 1/2023 - Das Magazin für Medien, Archive und Information (2023)

- Pause Giant AI Experiments - An Open Letter (Yoshua Bengio, Stuart Russell, Elon Musk, Steve Wozniak, Yuval Noah Harari) (2023)

- The ChatGPT King Isn’t Worried, but He Knows You Might Be (Cade Metz) (2023)

- ChatGPT kommt wie ein Erdbeben über uns (Doris Weßels, Dirk Reelfs, Laurén Haziak) (2023)

- Wie nah sind wir an der Superintelligenz? (Eva Wolfangel) (2023)

- Chatbots wie GPT können wunderbare Sätze bilden. Genau das macht sie zum Problem (Marie-José Kolly) (2023)

- Sparks of Artificial General Intelligence - Early experiments with GPT-4 (Sébastien Bubeck, Varun Chandrasekaran, Ronen Eldan, Johannes Gehrke, Eric Horvitz, Ece Kamar, Peter Lee, Yin Tat Lee, Yuanzhi Li, Scott Lundberg, Harsha Nori, Hamid Palangi, Marco Tulio Ribeiro, Yi Zhang) (2023)

- ChatGPT und andere Computermodelle zur Sprachverarbeitung - Grundlagen, Anwendungspotenziale und mögliche Auswirkungen (Steffen Albrecht) (2023)

- «The Godfather of A.I.» Leaves Google and Warns of Danger Ahead (Cade Metz) (2023)

- Chat GPTs als eine Kulturtechnik betrachtet - eine philosophische Reflexion (Sybille Krämer) (2023)

- «Wie erkennen wir, wenn ein System wie GPT die Welt versteht?» (Sam Altman, Jakob von Lindern, Jochen Wegner) (2023)

- «Angstmacherei ist nicht der Weg» (Andreas Krause, Joachim Laukenmann) (2023)

- «Wir haben 166 Nachrichtenseiten gefunden, die von KI geschrieben wurden» (Gordon Crovitz, Steven Brill, Pauline Voss) (2023)

- Können wir künstlicher Intelligenz vertrauen, Frau Zweig? (Katharina A. Zweig, Rudi Novotny, Stefan Schmitt) (2023)

- Kann ChatGPT Desinformation erkennen? (Katharina Zweig) (2023)

- The Coming Wave - Technology, Power, and the Twenty-first Century's Greatest Dilemma (Mustafa Suleyman, Michael Bhaskar) (2023)

- Wie klug ist künstliche Intelligenz? - Die 50 wichtigesten Fragen und Antworten (Hans-Martin Bürki-Spycher, Beat Döbeli Honegger, Mascha Kurpicz-Briki, Roman Schister) (2023)

- Guidance for generative AI in education and research (UNESCO United Nations Educational, Scientific and Cultural Org., Fengchun Miao, Wayne Holmes) (2023)

- Algorithmen texten Slogans für Schweizer Politiker (Georg Humbel) (2023)

- KI in der Schule (Florian Nuxoll) (2023)

- ChatGPT: Muss mich das interessieren? (2023)

- «Wenn Sie nicht in den nächsten Wochen in Rente gehen, müssen Sie das lernen» (Maximilian Gerl) (2023)

- »Etwas größenwahnsinnig« (Jaron Lanier, Götz Hamann, Jakob von Lindern) (2023)

- ChatGPT: Student aus Wedel entlarvt künstliche Intelligenz (Johannes Tran) (2024)

- Pädagogik 3/2024 - KI in der Schule (2024)

- Alles überall auf einmal - Wie Künstliche Intelligenz unsere Welt verändert und was wir dabei gewinnen können (Miriam Meckel, Léa Steinacker) (2024)

- Künstliche Intelligenz in der Schule - Chancen nutzen, Herausforderungen meistern (LCH Dachverband Schweizer Lehrerinnen und Lehrer) (2024)

- Chat-GPT macht Stimmung gegen Kiew (Gioia Da Silva) (2024)

- The impact of generative artificial intelligence on socioeconomic inequalities and policymaking (Valerio Capraro, Austin Lentsch, Daron Acemoglu, Selin Akgun, Aisel Akhmedova, Ennio Bilancini, Jean-François Bonnefon, Pablo Brañas-Garza, Luigi Butera, Karen Douglas, Jim Everett, Gerd Gigerenzer, Christine Greenhow, Daniel Hashimoto, Julianne Holt-Lunstad, Jolanda Jetten, Simon Johnson, Werner Kunz, Chiara Longoni, Pete Lunn, Simone Natale, Stefanie Paluch, Iyad Rahwan, Neil Selwyn, Vivek Singh, Siddharth Suri, Jennifer Sutcliffe, Joe Tomlinson, Sander van der Linden, Paul Van Lange, Friederike Wall, Jay Van Bavel, Riccardo Viale) (2024)

- Künstliche Intelligenz - wie Kinder im digitalen Zeitalter lernen (Beat Döbeli Honegger, Damian Haas) (2024)

- Die digitale Kalaschnikow (Ursina Haller) (2024)

- Generative KI – jenseits von Euphorie und einfachen Lösungen (Judith Simon, Indra Spiecker gen. Döhmann, Ulrike von Luxburg) (2024)

- Vorsicht, künstlich! - Kennzeichnungspflichten bei KI-erzeugten Bildern (Joerg Heidrich) (2025)

- Handbuch Lernen mit digitalen Medien (3. Auflage) - Wege der Transformation (Gerold Brägger, Hans-Günter Rolff) (2025)

- 1. Generative Machine-Learning-Systeme - Die nächste Herausforderung des digitalen Leitmedienwechsels (Beat Döbeli Honegger) (2025)

- 1. Generative Machine-Learning-Systeme - Die nächste Herausforderung des digitalen Leitmedienwechsels (Beat Döbeli Honegger) (2025)

- Wissenschaftliches Schreiben mit KI (Isabella Buck) (2025)

- Künstliche Intelligenz als Einfallstor für Hacker: Die neue Verwundbarkeit (Max Muth) (2026)

Biblionetz-History

Biblionetz-History