Zusammenfassungen

Zusammenfassungen

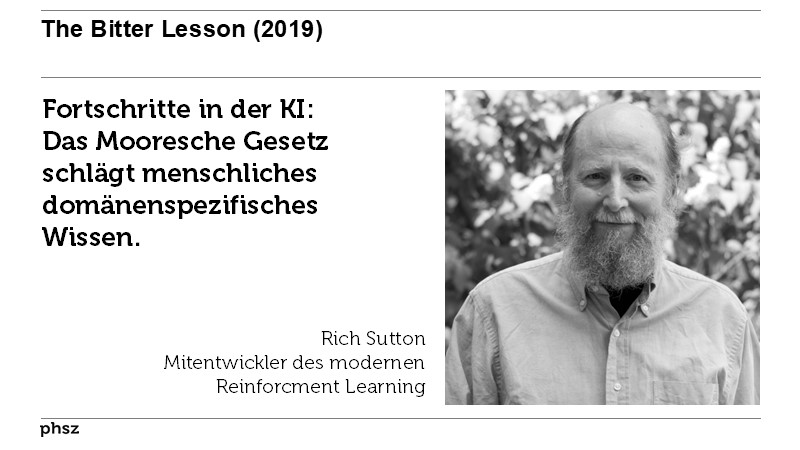

Beim Fortschritt im Bereich KI schlägt das Mooresche Gesetz menschliches domänenspezifisches Wissen.

Beim Fortschritt im Bereich KI schlägt das Mooresche Gesetz menschliches domänenspezifisches Wissen.The biggest lesson that can be read from 70 years of AI research is that general methods that leverage computation are ultimately the most effective, and by a large margin.

Von Rich Sutton im Text The Bitter Lesson (2019)  Fortschritte in der KI entstanden immer durch massiv zunehmende Rechenleistung und damit der allgemeinen Lernfähigkeit von KI-Systemen und nicht dadurch, dass man versucht hat, den KI-Systemen das bisher bekannte, domänenspezifische Wissen einzuprogrammieren.

Fortschritte in der KI entstanden immer durch massiv zunehmende Rechenleistung und damit der allgemeinen Lernfähigkeit von KI-Systemen und nicht dadurch, dass man versucht hat, den KI-Systemen das bisher bekannte, domänenspezifische Wissen einzuprogrammieren. Bemerkungen

Bemerkungen

A common refrain in the era of ever-larger models is the Bitter Lesson (Sutton, 2019): “General

methods that leverage computation are ultimately the most effective, and by a large margin.” Under

this perspective, one may expect benefits from incorporating linguistic structure or expert-designed

inductive biases to be superseded by learning mechanisms operating on fewer, more general principles

if they have enough training data and model capacity. While the success of deep learning and

large language models may be taken as supporting evidence for the Bitter Lesson, we find that the

community has bought into the Lesson far less than it thinks it has.

Von Julian Michael, Ari Holtzman, Alicia Parrish, Aaron Mueller, Alex Wang, Angelica Chen, Divyam Madaan, Nikita Nangia, Richard Yuanzhe Pang, Jason Phang, Samuel R. Bowman im Text What do NLP researchers believe? (2022)  Dieses Blogposting erwähnt ...

Dieses Blogposting erwähnt ...

Dieses Blogposting erwähnt vermutlich nicht ...

Dieses Blogposting erwähnt vermutlich nicht ...

Nicht erwähnte Begriffe | Automation (GPoC), Communication (GPoC), Coordination (GPoC), Recollection (GPoC) |

Tagcloud

Tagcloud

17 Vorträge von Beat mit Bezug

17 Vorträge von Beat mit Bezug

- ChatGPT & Co.: Klares und Unklares

Institutskonferenz F&E PH FHNW, 20.03.2023

- Schule, Digitalisierung und die Rolle der Informatik

Landesinformatiktag Hamburg und Schleswig-Holstein, 25.03.2023

- ChatGPT - der iPhone-Moment des maschinellen Lernens

AG Fremdsprachen Kammer PH swissuniversities, 25.05.2023

- ChatGPT - der iPhone-Moment des maschinellen Lernens

NMS Bern, 07.06.2023

- KVreform GPT

Kaufmännische Berufsschule Schwyz, 05.07.2023

- BBZGPT

Berufsbildungszentrum Goldau, 17.08.2023

- ChatGPT & Co. – eine Etappe auf der Reise nach Digitalien

CAS Lernreise, 19.01.2024

- Wenn ChatGPT in der Lehrer:innenbildung mitredet

(Video des Referats)

Tag der Lehre der PHZH, 01.02.2024

- Was will uns ChatGPT sagen?

8. Pädagogischer Dialog Liechtenstein, Vaduz, 21.02.2024

- Sprachmaschinen.

Deutschsprachige AG Fremdsprachen der EDK, PHZH, 20.03.2024

- Überfluten uns ChatGPT & Co.?

Tagung des Berufsverbands Schulleitungen Bern

Schwellenmätteli Bern, 24.05.2024

- GMLS - Wie sag ich‘s meinen Lehrer:innen (und der SL)?

Netzwerktreffen PICTS und ICT-Leiter:innen Kanton Schwyz, Uri & Glarus

PHSZ, 05.06.2024

- Generative Machine-Learning-Systeme in der Bildung

VR- und GL-Retraite der Orell Füssli Gruppe

Hasliberg, 12.06.2024

- Wenn das Digitale in der Bildung mitzureden beginnt

Bildungstag Kanton Glarus, 04.09.2024

- Zwischen Experimentierfreude und Überforderung

Kaderanlass, Schulkreis Uto Zürich, 03.06.2025

- Wir müssen über ChatGPT & Co. reden (lernen)

swissdidac Bern, 21.11.2025

- Die KI-Box der Pandora

Jährliche Informationsveranstaltung ICT der Bildungs- und Kulturdirektion Kanton Uri, Altdorf, 13.01.2026

Zitationsgraph

Zitationsgraph

Zitationsgraph (Beta-Test mit vis.js)

Zitationsgraph (Beta-Test mit vis.js)

8 Erwähnungen

8 Erwähnungen

- The Promise Of Artificial Intelligence - Reckoning And Judgment (Brian Cantwell Smith) (2019)

- The Atlas of AI (Kate Crawford) (2021)

- Data, Knowledge, and Computation (Christian Igel) (2021)

- What do NLP researchers believe? (Julian Michael, Ari Holtzman, Alicia Parrish, Aaron Mueller, Alex Wang, Angelica Chen, Divyam Madaan, Nikita Nangia, Richard Yuanzhe Pang, Jason Phang, Samuel R. Bowman) (2022)

- Skalierungshypothese vs. Neurosymbolik - Welche nächsten Schritte muss die KI-Forschung gehen? (Pina Merkert, Philipp Bongartz) (2022)

- AlphaCode and «data-driven» programming - Is ignoring everything that is known about code the best way to write programs? (J. Zico Kolter) (2022)

- Künstliche Intelligenz, Large Language Models, ChatGPT und die Arbeitswelt der Zukunft (Michael Seemann) (2023)

- SWK Talk «KI in der (Grund-)Schule» (Olaf Köller, Ulrike Cress, Tanja Reinlein, Beat Döbeli Honegger, Carina Geier, Isabelle Sieh) (2024)

Volltext dieses Dokuments

Volltext dieses Dokuments

|  The Bitter Lesson: Artikel als Volltext ( The Bitter Lesson: Artikel als Volltext ( : :  , 80 kByte; , 80 kByte;  : :  ) ) |

Anderswo suchen

Anderswo suchen

Beat und dieses Blogposting

Beat und dieses Blogposting

Beat hat Dieses Blogposting während seiner Zeit am Institut für Medien und Schule (IMS) ins Biblionetz aufgenommen. Beat besitzt kein physisches, aber ein digitales Exemplar. Eine digitale Version ist auf dem Internet verfügbar (s.o.). Beat hat Dieses Blogposting auch schon in Vorträgen erwähnt.

AlphaGo

AlphaGo Computation (GPoC)

Computation (GPoC) Computer

Computer deep learning

deep learning Künstliche Intelligenz (KI / AI)

Künstliche Intelligenz (KI / AI) Moore's law

Moore's law Schach

Schach Biblionetz-History

Biblionetz-History